先週、Lytro(ライトロ)という会社が開発した世にも不思議なカメラの話題がネットを駆け巡りました。このカメラのキャッチフレーズは「Shoot Now, Focus Later(今撮影して、フォーカスはのちほど)」。そう、このカメラで撮影した写真は、あとから好きなポイントにピントを合わせることができるというのです。百聞は一見にしかず。まずはプロモ映像とサンプル写真データをご覧ください。

http://www.youtube.com/watch?v=7babcK2GH3I

※ 写真の中の任意の場所をクリックすると、そこにピントが合います。

●「ライトフィールド」とはなにか?

●「ライトフィールド」とはなにか?

Lytro は、米・スタンフォード大学で開発された「ライトフィールド・カメラ(Light Field Camera)」です。

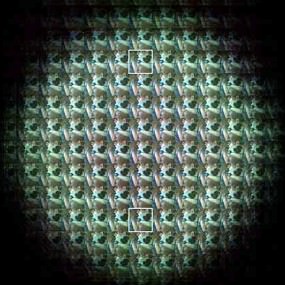

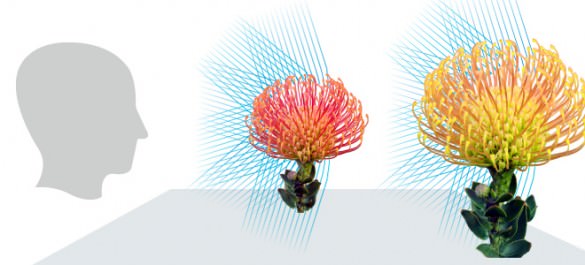

ライトフィールドとは “ある時、ある場所に存在する光の状態をすべて記録した情報” とでも言うべき概念で、専用のライトフィールド・センサーで記録します。

ライトフィールド・センサーの前には無数の小さなレンズが並んでおり、その一つ一つが、その場所に在る光の波長、強さ、方向に関する情報をセンサーに送ります。

ただし、奥行き方向の情報を記録することにセンサーの能力の大半が使われてしまうため、たとえば iPhone4カメラと同じ「500万画素相当」程度の画像を出力するためでも、なんと!1億ピクセル級のセンサーが必要!という弱点を抱えています。なので、今年末までにはこの技術をコンシューマー製品に落とし込んで世に送り出したい Lytro 社ではあるものの、当初は VGA(640x480)クラスの写真が撮れるパーティカメラが精一杯では?とみられています。

ボクなど「光の状態をすべて記録」と聞いて、それってホログラムのこと?と思ってしまったのですが、Lytro のサイトでは特に触れられていませんでした(爆)。

Blade Runner © 1982 Warner Bros.

Blade Runner © 1982 Warner Bros.

⬆ あのあまりにも有名な「ブレード・ランナー」の1シーン。

デッカード(ハリソン・フォード)がレプリカントの隠れ家で見つけたスナップ写真を見ています。一見、僕らの知っている “ただの写真” ですが、実はこれ、未来のホログラム写真です。デッカードが写真を解析装置の中に入れ、座標や方向、拡大・縮小などのコマンドを口にすると、装置が動いて写真の中の風景が無限に拡大し解像します。そればかりか、二次元の写真ではあり得ないことですが、写真に写っている物体を回り込んで、撮影時にうしろにいた人物や物まで見ることができます。…非常に乱暴に言うと、これが ホログラム的な光学情報記録 ですね(いや乱暴すぎだけど!?)。

この場合、ブレード・ランナーに出てくる写真が記録しているのは、まさに Lytro社が言うところの「ライトフィールド」といって良いのではないでしょうか?

反面、“光の状態をすべて記録する” と謳っている Lytroではありますが、サンプルの映像や写真を見る限りでは、「屈折/反射した光の情報」までは記録できないようです。従って、ブレード・ランナーとは違って、物体のうしろにあるものを回り込んで見ることはできません。

…こういう言い方はとても失礼ですが、ぶっちゃけ!あとからピントの位置を変えられるだけじゃん?とも言えてしまうのです。

ちょっと微妙なんですが、このニュースが流れてきた時、正直、ボクはこれといってインパクトを感じませんでした。パンフォーカスで撮影した写真の不要な部分を、後処理でボケさせるのと同じようなもんじゃん?って(笑)。そんなこと、Photoshopが登場した20年前から、みんな(グラフィックデザイナーなら誰でも)やってますから…。

と、話の流れ的に丁度良いタイミングで(笑) Photoshopが出てきましたが、Adobeも同じコンセプトの技術デモをすでに2008年の時点で行ってましたよね。

と、話の流れ的に丁度良いタイミングで(笑) Photoshopが出てきましたが、Adobeも同じコンセプトの技術デモをすでに2008年の時点で行ってましたよね。

Adobe さんのアプローチは、普通の一眼レフで使える「プレノプティック・レンズ(Plenoptic Lens)」という特殊な光学レンズで「同一アングル」+「合焦ポイントが異なる」何十枚もの写真を記録し、ソフト的にそれらを束ねてファイル化する。そして、あとで必要に応じてピントを合わせたい部分に合焦データを持ってくればいい、といったものでした。

すっかり忘れていましたが、そういえばその後どうなったんでしょうか?

…と思って調べてみたら、やはり上記(1億画素センサーで、ようやく500万画素の写真)の理由により、もっとセンサーサイズの大きな(最低でも3200万画素以上の)デジタル一眼が登場するまで “技術革新待ち” だそうです(ちなみに、プレノプティックレンズのプロトタイプはとっくに完成しているそうな)。

http://www.youtube.com/watch?v=-EI75wPL0nU

う〜ん、どうですか? 皆さん的には魅力的な技術でしょうか? マヌケなボクが気づいていない無限の可能性等、何かお気づきのポイントがありましたら、是非教えてください。

【情報ソース】

▶ TAKING LIVING PICTURES

▶ CINEMA5D | Lytro: Why u can decide what’s in focus AFTER taking the shot

▶ planet5Dblog | Shoot first, focus later! Are “focus free” cameras in your future?

▶ Philip Bloom | Dark magic camera that let’s you choose what is in focus AFTER taking the photo

▶ Film and Digital Times | Focus After the Fact

▶ EOSHD | Adobe also working on focus-free camera system

Archives

- 2017年7月 (1)

- 2017年6月 (1)

- 2017年2月 (1)

- 2017年1月 (1)

- 2016年12月 (1)

- 2016年8月 (1)

- 2016年6月 (2)

- 2016年5月 (5)

- 2016年3月 (1)

- 2015年12月 (1)

- 2015年11月 (1)

- 2015年10月 (1)

- 2015年9月 (1)

- 2015年8月 (7)

- 2015年4月 (3)

- 2014年9月 (1)

- 2014年4月 (3)

- 2014年2月 (3)

- 2014年1月 (3)

- 2013年12月 (2)

- 2013年11月 (1)

- 2013年10月 (1)

- 2013年9月 (3)

- 2013年8月 (2)

- 2013年5月 (6)

- 2013年4月 (8)

- 2013年3月 (9)

- 2013年2月 (20)

- 2013年1月 (9)

- 2012年12月 (3)

- 2012年11月 (10)

- 2012年10月 (7)

- 2012年9月 (17)

- 2012年8月 (4)

- 2012年7月 (7)

- 2012年6月 (8)

- 2012年5月 (5)

- 2012年4月 (19)

- 2012年3月 (12)

- 2012年2月 (7)

- 2012年1月 (7)

- 2011年12月 (7)

- 2011年11月 (20)

- 2011年10月 (9)

- 2011年9月 (16)

- 2011年8月 (12)

- 2011年7月 (11)

- 2011年6月 (15)

- 2011年5月 (4)

- 2011年4月 (1)

- 2011年3月 (6)

- 2011年2月 (2)

- 2011年1月 (3)

- 2010年11月 (2)

- 2010年9月 (4)

- 2010年6月 (3)

- 2010年5月 (14)

- 2010年4月 (13)

2 Comments

奥行き情報を記録するというのは昔、背景にクロマキースクリーンなどを置かなくても

切り抜き合成ができるというので登場したことがありますがあまり綺麗に

合成できないということですぐ消えたようです。

フォトショップで切り抜いて背景をぼかそうとすると被写体のエッヂが背景に溶け込んでうまくいきませんよね。僕はペイントで人物のエッヂを消し込んでますが(^_^;)

それを多眼で捉えてボケデータを生成しようと言うように見えるのですがどうでしょう?

つまり一つずつのレンズで捉えた映像はパンフォーカスということなんでしょうね。

レンズの光軸を外れた視線の映像は念写でないと撮れませんから(笑)

多眼の配置サイズがレンズ口径のボケと同様になる…みたいな。

DOF映像が流行っているとはいえここまでしてやらなくても・・・と思います(笑)

今改めて冷静に、このニュースに触れた際に感じた感情的リアクション=「ふんっ!」という気分の原因を考えてみますに、たぶん fujinonさんの最後の一行のような気分になったのかな?と思われます。

なぜそこまでして?とか、最初から多焦点で撮影すりゃいいじゃん!とか、つまりは、「ボケ」のような職人技をノンリニア処理でなんとかしようという発想が気に入らなかったのかも知れません。

…普段、思いっ切りノンリニアの恩恵に浴して仕事をしている自分がこんな事を言うのは、我ながら笑止千万ではありますが…(笑)。